2026/01/30

AI

TPUとは?CPU・GPUとの違い|AIインフラ基礎

目次

TPUとは(まずは意味の整理)

「TPU」は文脈によって意味が変わります。代表的には、①AI計算向けのプロセッサ「TPU(Tensor Processing Unit)」、②素材としての「TPU(熱可塑性ポリウレタン)」の2つです。

この記事では、ビジネス現場で話題になりやすいAI向けのTPU(Tensor Processing Unit)について、CPU・GPUとの違い、導入判断、運用のコツまでをまとめます。

TPU(Tensor Processing Unit)の概要

TPUは、機械学習で頻出する「行列演算(テンソル計算)」を高速・高効率に処理するために設計された専用プロセッサ(ASICの一種)です。汎用のCPUが幅広い処理に強いのに対し、TPUは機械学習に必要な計算を得意分野に絞って最適化しているのが特徴です。

なぜTPUが注目されるのか

- 推論(Inference)のコストと速度が事業に直結しやすい(チャットボット、検索、レコメンドなど)

- GPU不足・価格変動の影響を受けにくい選択肢として検討される

- クラウド上で大規模にスケールさせやすい(大量同時処理を前提とした設計思想)

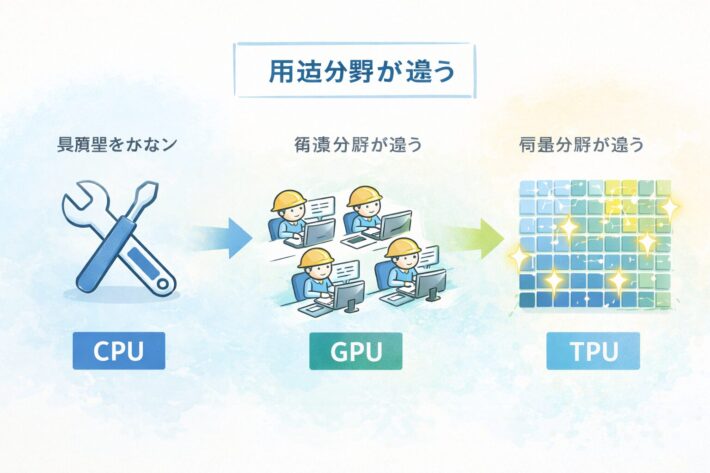

CPU・GPU・TPUの違い(得意な仕事が違う)

結論から言うと、「どれが上位互換」ではなく向いている作業が違うため、目的別に使い分けます。

| 項目 | CPU | GPU | TPU |

|---|---|---|---|

| 得意な処理 | 分岐が多い汎用処理、OS・アプリ全般 | 並列計算、画像処理、深層学習全般 | テンソル/行列演算中心の機械学習(特化) |

| 強み | 万能・互換性が高い | エコシステムが大きい、柔軟性が高い | 特定ワークロードで高効率(速度・電力・単価)を狙える |

| 弱み | 学習/推論の大規模並列は不利 | 価格/供給の影響、構成で差が出る | 使える環境が限定的、設計思想に合わないと旨味が出にくい |

| 導入のしやすさ | 最も簡単 | 比較的容易(環境構築は必要) | クラウド前提で設計・運用を合わせる必要がある |

| 向く用途 | 業務システム、ETL、軽量ML | 研究開発、画像/音声、汎用DL | 大規模推論、特定フレームワーク前提の学習/推論 |

「GPUとTPU、結局どっち?」の考え方

迷ったらまずGPUで検証し、推論が事業のボトルネックになった段階でTPU検討が現実的です。TPUは「刺さると強い」反面、運用・設計・周辺ツールを合わせないと効果が出にくいケースがあります。

TPUがハマりやすいパターン

- 推論リクエストが多く、1回あたりコストが効いてくる

- モデルや処理がテンソル計算中心で、ボトルネックが明確

- クラウド上でのスケーリング(台数増減)を前提にしている

TPUで苦戦しやすいパターン

- 特殊なオペレーターや独自実装が多く、移植コストが大きい

- 検証が頻繁で構成を変え続ける(柔軟性が最優先)

- 小規模で、CPU/GPUでも十分に間に合っている

TPUを検討すべき企業・チーム(導入判断のチェックリスト)

TPUは「AIに本腰を入れる企業」が検討する選択肢ですが、全社一斉導入よりも用途を絞った段階導入が失敗しにくいです。

導入判断の5ステップ

- 目的を固定する(学習か推論か、SLAは何か、どこが遅いのか)

- 現状の計測(レイテンシ、スループット、1リクエスト単価、ピーク時負荷)

- 候補を並列比較(CPU/GPU/TPUで同条件ベンチ、運用込みで評価)

- 運用要件の確認(監視、障害対応、セキュリティ、権限、データ所在)

- スモールスタート(1サービス or 1モデルで先に成果を出す)

「コスト」だけで決めないほうがいい理由

TPUはコスト効率が魅力になり得ますが、現場では「運用コスト(人・手順・教育)」がじわじわ効きます。たとえば、環境構築が属人化すると、障害対応や引き継ぎで詰まりやすくなります。導入前に、手順を標準化して共有できる状態を作るのが重要です。

TPUを使う流れ(クラウド運用を前提にイメージする)

TPUはクラウドで提供されることが多いため、オンプレのサーバ調達とは考え方が変わります。ここでは「ざっくり全体像」を掴むための流れを紹介します(詳細は利用クラウドやフレームワークで変わります)。

全体の流れ(ざっくり)

- 用途を決める(学習/推論、オンライン/バッチ)

- データの置き場所と権限を設計する(機密区分、ログ、監査)

- モデルの実行環境を整える(コンテナ、依存関係、再現性)

- 監視・アラート・ロールバックを用意する(止め方まで決める)

- 小さく本番投入→計測→改善(ピーク時の挙動まで確認)

よくある落とし穴

- 「速くなった気がする」で終わり、指標が残らない(改善の再現ができない)

- 権限設計が曖昧で、後から監査・棚卸しが地獄になる

- 障害時の切り戻し手順がなく、夜間対応が属人化する

社内でTPU活用を定着させる「教育」と「標準化」

TPUに限らず、AIインフラは「詳しい人が1人いる」状態だと運用が詰みがちです。定着のコツは、手順を短く分解して、誰でも再現できる形にすることです。

動画マニュアルが効く場面(TPU運用の例)

- 環境構築(プロジェクト作成、権限付与、実行ジョブの流れ)

- 推論デプロイ(更新手順、カナリア、ロールバック)

- 障害対応(アラート確認、一次切り分け、連絡テンプレ)

- コスト監視(ダッシュボードの見方、異常検知の判断基準)

マイクロラーニング化(5〜10分で回す)

「長い研修」は忘れられます。TPU運用は変更も多いので、手順を5〜10分の小さな単位に分け、更新しやすくするのが現実的です。たとえば次のように分割します。

- 「TPUで推論を回す全体像(5分)」

- 「権限付与のやり方(7分)」

- 「デプロイと切り戻し(9分)」

- 「アラートが鳴った時の初動(6分)」

標準化チェックリスト(最小セット)

- 手順書は「誰が見ても同じ結果」になる粒度か

- スクリーンショット/画面録画で迷いどころが潰れているか

- 例外パターン(失敗時・権限不足時)も含めているか

- 更新担当と更新頻度が決まっているか

関連記事

まとめ

TPUは機械学習のテンソル計算に特化したプロセッサで、CPU・GPUとは得意領域が異なります。推論の処理量が多い、コストや効率を詰めたい場面で検討価値が高い一方、運用や標準化が鍵です。小さく比較検証し、手順を動画マニュアル化して属人化を防ぐと、導入効果を継続しやすくなります。

Posts by Topic

- 3T'sの特徴(9)

- AI(35)

- DX(35)

- LMS(3)

- セキュリティ(8)

- ビジネス(20)

- ビジネススキル(24)

- ヘルプ(1)

- マニュアル作成の基礎(17)

- メディア掲載(1)

- リスキリング(7)

- 事務に役立つツール(12)

- 動画マニュアル(124)

- 動画撮影(8)

- 動画編集(15)

- 動画編集アプリ(7)

- 外国人労働者(3)

- 導入事例(3)

- 技術継承(9)

- 新人教育(23)

- 未分類(3)

- 用語辞典(20)

- 社内教育(24)

おすすめ記事

- サイクルタイム・タクトタイム・リードタイムの違いは?製造現場の基本と短縮手順をやさしく解説|計測・ボトルネック特定・改善例まで

- 【2025年保存版】Microsoft Officeで簡単マニュアル作成術!EXCEL・PowerPoint・Word活用法

- AI翻訳×動画マニュアルでインバウンド対策を強化!3T’sが提供する最新ソリューションの魅力

- マニュアル作成は誰がするべきか?役割分担の最適解

- Z世代の心をつかむ!動画を活用した新人教育の最新手法

新着記事